आज की डिजिटल दुनिया में एक ऐसी तकनीक उभर रही है जो मस्ती के साथ-साथ भयानक खतरे भी ला रही है। डीपफेक – आर्टिफिशियल इंटेलिजेंस (DeepFake AI) की मदद से बनाए गए फर्जी वीडियो, फोटो या ऑडियो, जो इतने वास्तविक लगते हैं कि सच और झूठ का फर्क करना मुश्किल हो जाता है। न्यूज़ीलैंड की संसद में सांसद लॉरा मैक्लर की चौंकाने वाली हरकत से लेकर रश्मिका मंदाना और सद्गुरु जैसे भारतीय हस्तियों के डीपफेक मामले तक, यह तकनीक दुनिया भर में तहलका मचा रही है। आइए, इस डिजिटल खतरे की गहराई में उतरें और समझें कि यह क्या है, इसके खतरे क्या हैं और इससे कैसे बचा जा सकता है।

न्यूज़ीलैंड: लॉरा मैक्लर का साहसिक कदम

14 मई 2025 को न्यूज़ीलैंड की संसद में एक हैरान करने वाला नजारा देखने को मिला। सांसद लॉरा मैक्लर ने संसद में अपनी एक AI-जनरेटेड न्यूड तस्वीर दिखाई, जिसे उन्होंने खुद सिर्फ 5 मिनट में बनाया था। यह तस्वीर डीपफेक तकनीक का नमूना थी, और उनका मकसद था लोगों को इस तकनीक के खतरों के प्रति जागरूक करना। इस घटना ने पूरी संसद को स्तब्ध कर दिया।

लॉरा ने बताया कि डीपफेक का शिकार होने वाली एक 13 साल की लड़की ने आत्महत्या का प्रयास किया था। इस घटना ने न्यूज़ीलैंड में डीपफेक के खिलाफ सख्त कानून बनाने की मांग को तेज कर दिया। लॉरा का कहना था, “यह तकनीक हमारी निजता, सम्मान और विश्वास को तहस-नहस कर सकती है।”

डीपफेक क्या है?

डीपफेक (Deepfake) शब्द “डीप लर्निंग” और “फेक” से मिलकर बना है। यह AI और मशीन लर्निंग की मदद से बनाया गया सिंथेटिक मीडिया है, जिसमें किसी व्यक्ति के चेहरे, आवाज या हावभाव को किसी और के साथ बदल दिया जाता है। उदाहरण के लिए, किसी का चेहरा दूसरे के शरीर पर चिपकाना या फर्जी आवाज बनाना। यह तकनीक मस्ती के लिए मजेदार हो सकती है, लेकिन इसका दुरुपयोग खतरनाक है – फर्जी खबरें, धोखाधड़ी, बदनामी, और यहां तक कि युद्ध में प्रचार के लिए इसका इस्तेमाल हो रहा है।

5 मिनट में बनने वाला डीपफेक आपकी जिंदगी खराब कर सकता है!

टेलर स्विफ्ट: डीपफेक का सेलिब्रिटी शिकार

जनवरी 2024 में मशहूर पॉप स्टार टेलर स्विफ्ट की डीपफेक अश्लील तस्वीरें और वीडियो सोशल मीडिया पर वायरल हो गए। लाखों लोगों ने इन्हें देखा, जिससे AI के दुरुपयोग पर बहस छिड़ गई। इस घटना ने अमेरिका में कानून निर्माताओं को सख्त कदम उठाने के लिए मजबूर किया। 2025 में ‘Take It Down Act’ लागू हुआ, जिसके तहत डीपफेक यौन सामग्री को आपराधिक माना गया। मेटा की एक रिपोर्ट के मुताबिक, 70% लोग असली और डीपफेक आवाज में फर्क नहीं कर पाते।

यूक्रेन-रूस युद्ध: डीपफेक का प्रचार हथियार

डीपफेक का इस्तेमाल सिर्फ सेलिब्रिटीज तक सीमित नहीं है। मार्च 2022 में रूस-यूक्रेन युद्ध के दौरान यूक्रेन के राष्ट्रपति वोलोदिमिर ज़ेलेंस्की का एक फर्जी डीपफेक वीडियो वायरल हुआ। 68 सेकंड के इस वीडियो में उन्हें अपने सैनिकों से हथियार डालने और रूस के सामने आत्मसमर्पण करने की बात कहते दिखाया गया। हालांकि, गलत उच्चारण, चेहरे का असामान्य आकार और पिक्सलेशन ने इसे फर्जी साबित किया। यूक्रेन सरकार ने तुरंत इसे खारिज किया, लेकिन इसने दिखाया कि डीपफेक युद्ध जैसे संवेदनशील हालात में गलत सूचना और अविश्वास फैला सकता है। Center for Strategic and International Studies (CSIS) की 2024 की रिपोर्ट के अनुसार, मानव आंख और कान अब डीपफेक की पहचान करने में असमर्थ हैं, जिससे डिटेक्शन तकनीकों की जरूरत बढ़ गई है।

साउथ कोरिया: डीपफेक यौन अपराधों का कहर

2024 में साउथ कोरिया में डीपफेक यौन अपराधों के 297 मामले दर्ज हुए, जिनमें 53% वैश्विक डीपफेक कंटेंट कोरियाई सेलिब्रिटीज, खासकर महिलाओं और किशोरों से संबंधित था। इसके जवाब में सितंबर 2024 में साउथ कोरिया ने डीपफेक कंटेंट को देखने या रखने को अपराध घोषित किया, जिसमें 7 साल की जेल की सजा का प्रावधान है। हालांकि, टेलीग्राम जैसे प्लेटफॉर्म्स पर गुप्त चैट्स इसे रोकने में चुनौती बने हुए हैं।

ये भी पढ़ें : फार्मेसी काउंसिल : पदाधिकारियों ने अपने के भत्ते बढ़ा लिए और भरपाई के लिए रजिस्ट्रेशन शुल्क में कर दी भारी वृद्धि

भारत में डीपफेक का बढ़ता खतरा

भारत भी डीपफेक के खतरों से अछूता नहीं है। कुछ प्रमुख मामले:

रश्मिका मंदाना: 2023 में रश्मिका का डीपफेक वीडियो वायरल हुआ, जिसमें एक ब्रिटिश-भारतीय लड़की के चेहरे को AI के जरिए उनके चेहरे से बदल दिया गया। इस मामले में दिल्ली पुलिस ने वीडियो बनाने वाले को गिरफ्तार किया।

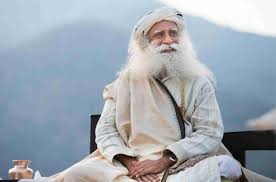

सद् गुरु: 2025 में आध्यात्मिक गुरु सद् गुरु की आवाज और वीडियो का दुरुपयोग हुआ। दिल्ली हाईकोर्ट ने इसके खिलाफ ‘डायनामिक+ इंजक्शन’ आदेश जारी किया, जो नई वेबसाइट्स या सोशल मीडिया अकाउंट्स पर डीपफेक कंटेंट को तुरंत हटाने की अनुमति देता है।

असदुद्दीन ओवैसी: AIMIM नेता के चेहरे का इस्तेमाल फर्जी निवेश स्कीम के लिए किया गया।

रवीश कुमार: वरिष्ठ पत्रकार रवीश कुमार की आवाज और छवि का उपयोग फर्जी विज्ञापनों में हुआ। दिसंबर 2023 में मधुमेह की दवा और फरवरी 2024 में एक बेटिंग ऐप को बढ़ावा देने वाले डीपफेक वीडियो वायरल हुए। रवीश ने इसे फर्जी बताकर लोगों को सावधान किया।

डीपफेक की तकनीकी चुनौतियां और आंकड़े

2024 में भारत में डीपफेक धोखाधड़ी में 280% की वृद्धि हुई, और 2022 से 2023 तक यह 10 गुना बढ़ी। 2025 में 80 लाख स्कैम होने की संभावना है, और 2027 तक $40 बिलियन का नुकसान हो सकता है। Generative Adversarial Networks (GANs) और Variational Autoencoders (VAEs) जैसी तकनीकें डीपफेक को विश्वसनीय बनाती हैं, जबकि डिटेक्शन टूल्स अभी पीछे हैं।

डीपफेक से कैसे बचें?

डीपफेक के इस जाल से बचने के लिए कुछ कदम जरूरी हैं:

संदिग्ध कंटेंट की जांच करें: वीडियो में असामान्य पिक्सलेशन, गलत लिप-सिंक या बैकग्राउंड में धुंधलापन देखें।

मल्टी-फैक्टर ऑथेंटिकेशन: ऑनलाइन खातों को सुरक्षित रखें।

डीपफेक डिटेक्शन टूल्स: Deepware Scanner या Intel FakeCatcher जैसे टूल्स का उपयोग करें जो 95% सटीकता के साथ फर्जी कंटेंट पकड़ सकते हैं।

जागरूकता अभियान: सरकारों और सोशल मीडिया प्लेटफॉर्म्स को सख्त कानून और जागरूकता अभियानों पर जोर देना चाहिए।

ये भी पढ़ें : क्या एआई खत्म कर देगा नौकरियां? मिडिल क्लास के लिए क्या है चुनौती?